La Unión Europea reactivó en 2025 el debate sobre el Reglamento para prevenir y combatir el abuso sexual infantil en línea (apodado “Chat Control”), una propuesta que la Comisión Europea presentó originalmente en mayo de 2022 que permitiría emitir órdenes de detección para que plataformas y servicios de mensajería escaneen contenidos privados en busca de material de abuso infantil y grooming. La polémica surge en que ese fin solo podría ser una justificación ante la búsqueda de vigilar los mensajes de los ciudadanos europeos.

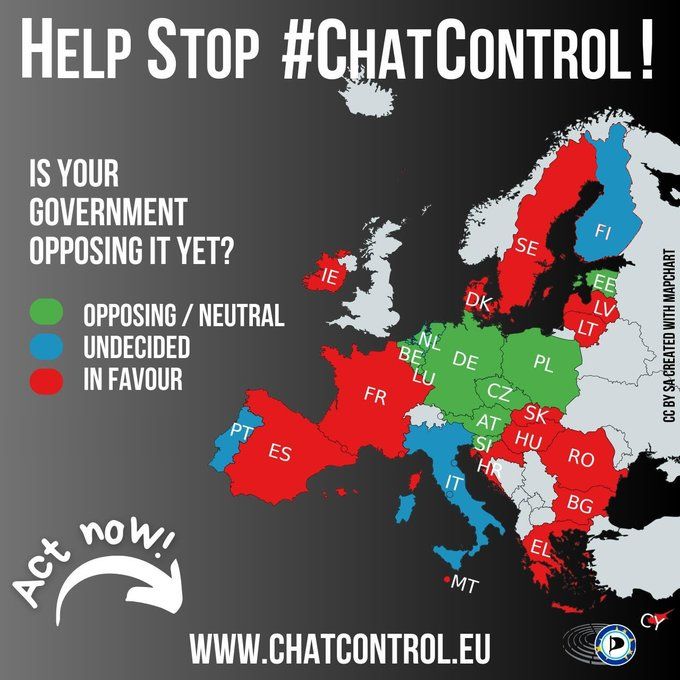

El texto sigue en discusión en el Consejo de la UE: hay una sesión clave señalada para septiembre y se ha mencionado el 14 de octubre de 2025 como fecha tentativa para buscar una posición general si existen mayorías suficientes. El mapa político está dividido (más países se han sumado a la oposición, aunque el bloque a favor sigue siendo numeroso) y el núcleo de la controversia es el posible escaneo de comunicaciones cifradas. Si el Consejo adopta una posición, el expediente pasará a trílogos con el Parlamento y la Comisión, donde el contenido aún puede cambiar.

El llamado “Chat Control” es el Reglamento para prevenir y combatir el abuso sexual infantil en línea propuesto por la Comisión Europea en mayo de 2022. Crea un marco obligatorio para que plataformas y servicios de mensajería detecten, reporten y retiren material de abuso sexual infantil (CSAM) y, cuando una autoridad lo ordene, apliquen “órdenes de detección” para identificar tanto CSAM conocido y nuevo como posibles casos de grooming. Sustituye el esquema voluntario por deberes legales armonizados en toda la UE.

Para hacer cumplir esas órdenes, el texto admite tecnologías de escaneo de comunicaciones incluso cuando los servicios usan cifrado de extremo a extremo (E2EE). Eso suele implicar client-side scanning (analizar fotos, textos o audios antes de cifrarlos en el dispositivo), con la premisa de encontrar indicios de CSAM/grooming y notificar a autoridades. La obligación abarca no solo coincidencias con hashes de CSAM “conocido”, sino también detección de contenido nuevo y patrones conversacionales de solicitación, objetivos técnicamente mucho más complejos.

La finalidad —combatir un delito gravísimo— es justa y necesaria, pero autoridades de protección de datos (EDPB/EDPS) y expertos advierten que el escaneo generalizado de comunicaciones privadas puede socavar el cifrado, abrir la puerta a errores y falsos positivos y, con el tiempo, desviarse hacia otros usos (más allá de CSAM), lo que algunos califican como riesgo de vigilancia masiva. De ahí el dilema central: ¿cómo proteger a la niñez sin debilitar garantías básicas de privacidad y seguridad digital?

A 2 de septiembre de 2025, el expediente no es ley: está en manos del Consejo de la UE. Bajo la Presidencia danesa (iniciada el 1 de julio de 2025), las capitales trabajan una posición general con dos hitos en agenda: 12 de septiembre (intento de cierre político) y 14 de octubre de 2025 (primera fecha posible de votación en el Consejo). Si hubiese mayoría cualificada, el texto pasaría a trílogos con el Parlamento y la Comisión, donde aún podría modificarse.

El mapa de apoyos está dividido: medios especializados reportan que creció el bloque de países opuestos (se sumaron, por ejemplo, Bélgica y Chequia, junto a Austria, Países Bajos y Polonia), mientras que 15 Estados —incluidos Francia, Italia y España— seguirían a favor; la abstención de Alemania podría ser decisiva. En paralelo, campañas ciudadanas y eurodiputados advierten sobre los riesgos a derechos fundamentales si se aprueba el escaneo de comunicaciones.

Para los proveedores de mensajería, las órdenes de detección implicarían desarrollar o integrar tecnologías capaces de escanear contenidos privados (texto, imágenes, audio) en busca de CSAM y posibles patrones de grooming. En servicios con cifrado extremo a extremo (E2EE), eso normalmente supone escaneo en el dispositivo (client-side scanning), es decir, analizar antes de cifrar. Expertos independientes (EDPB/EDPS, Internet Society) advierten que este enfoque socava el E2EE, aumenta la superficie de ataque y puede generar falsos positivos difíciles de gestionar a escala. Si el Consejo adopta una posición general en septiembre/octubre, el sector tendría que prepararse para cumplimientos técnicos que hoy siguen en disputa.

En apps nativamente E2EE como Signal (y la capa cifrada de WhatsApp), el dilema es binario: mantener el cifrado intacto (lo que impediría cumplir órdenes de escaneo de contenido) o insertar escaneo previo que, de facto, rompe el modelo de seguridad. La presidenta de Signal, Meredith Whittaker, ha reiterado que “no hay manera de preservar la integridad del E2EE y exponer el contenido al escaneo” y que el rebautizado “upload moderation” sigue siendo escaneo masivo con otros términos. Señales públicas del ecosistema apuntan a que, de aprobarse el texto sin salvaguardas, algunos servicios limitarían funciones o incluso evaluarían su continuidad en la UE.

Telegram es un caso particular: no cifra por defecto los chats “en la nube”; solo los Secret Chats son E2EE. Eso significa que el escaneo de contenido en chats normales podría implementarse del lado del servidor con menos fricción técnica que en E2EE; pero si las órdenes alcanzan también a Secret Chats, Telegram tendría que optar por client-side scanning en ese modo o restringir esa función cifrada para usuarios de la UE. Para el público, es clave la precisión: Telegram solo ofrece E2EE en Secret Chats, como confirman su FAQ oficial y guías de referencia, y agencias como AP lo recuerdan al comparar mensajerías.

A favor. La Comisión Europea y organizaciones de protección de la niñez sostienen que, sin un marco obligatorio, la detección y reporte de CSAM queda fragmentada e insuficiente; por eso el Reglamento crea deberes armonizados y faculta órdenes de detección para identificar CSAM “conocido y nuevo” y posibles casos de grooming. El objetivo declarado es salvar víctimas y cerrar brechas entre países y servicios, incluso cuando el material circule en mensajerías populares. Grupos proinfancia han respaldado la necesidad de herramientas más eficaces, y el expediente se presenta como respuesta a mandatos previos del Consejo y el Parlamento.

Objeciones. Autoridades europeas de datos (EDPB/EDPS), operadores y expertos alertan que el escaneo generalizado (incluido el client-side scanning) socava el E2EE, abre superficies de ataque, y puede producir falsos positivos, con impacto en derechos fundamentales. La GSMA advierte que ciertas expectativas no son técnicamente proporcionadas (p. ej., escaneo de audio); redes civiles (EDRi) denuncian el riesgo de vigilancia masiva y ampliación de fines. Desde la industria, Signal ha señalado que renombrar el escaneo como “moderación de subida” no resuelve el problema: sigue siendo incompatible con cifrado robusto.

A septiembre–octubre de 2025, el texto no es ley: el Consejo busca una posición general (12 de septiembre como hito político; 14 de octubre como primera ventana de votación). De prosperar, abriría trílogos con el Parlamento, donde aún podrían introducirse salvaguardas o límites a las órdenes de detección. El resultado dependerá del equilibrio de Estados: crece el bloque crítico (Bélgica, Chequia, Austria, Países Bajos, Polonia), pero aún hay apoyos relevantes (Francia, Italia, España).

Más allá del desenlace legislativo, el debate ya fijó el dilema central: cómo proteger a la niñez sin debilitar el cifrado que resguarda comunicaciones, periodistas, activistas y empresas. Para redacciones y equipos técnicos, la cobertura debería seguir fechas del Consejo, mapear impactos por servicio (E2EE vs. nube) y explicar al usuario por qué el E2EE importa en su vida diaria (no solo en apps “de nicho”). Si el texto avanza sin cambios sustantivos, las plataformas tendrán que elegir entre degradar el modelo cifrado, limitar funciones en la UE o replantear su operación.

Un comentario

primero en llegar