En la era digital, la tecnología se desarolla a pasos agigantados, brindando oportunidades, pero también nuevos desafíos. Dentro de estos desafíos encontramos el Deep Fake, una herramienta basada en inteligencia artificial que permite manipular imágenes, audios y videos para hacer que las personas digan o hagan cosas que nunca sucedieron en la realidad. Esto tiene el potencial de representar una amenaza emergente que puede alterar la confianza en la información y manipular la opinión pública.

La capacidad de esta herramienta va más allá de la simple alteración del contenido, sino que debido a su alto nivel de realismo, la convierte en un arma que puede ser utilizada para la desinformación masiva, la suplantación de identidad, el fraude financiero e incluso para comprometer la seguridad nacional. La facilidad con la que los Deep Fakes pueden ser distribuidos en redes sociales y plataformas digitales agrava el problema, ya que pueden influir en la percepción de la realidad, manipular procesos electorales y socavar la credibilidad de instituciones y figuras públicas.

La tecnología detrás del Deep Fake consiste en algoritmos de aprendizaje complejos llamados deep learning y redes generativas antagónicas (GANs). Estos sistemas ven la inmensidad de datos visuales y de audio para aprender patrones y reproducirlos de manera fiel en nuevas producciones. El proceso implica entrenar modelos con imágenes y sonidos realistas, para que, posteriormente, sean capaces de generar contenido manipulado indistinguible del original.

Este proceso involucra la competencia entre dos redes neuronales: un generador, que crea el contenido falso, y un discriminador, que evalúa su autenticidad y ayuda a perfeccionar la calidad de la manipulación. El avance de esta tecnología permite tanto la modificación de rostros y voces en videos, como la creación de identidades sintéticas que manipulan en tiempo real las expresiones faciales y gestos. Su creciente accesibilidad ha impulsado aplicaciones en diversos campos, desde el entretenimiento y la publicidad, terminando en estrategias de desinformación y fraude digital como ya adelantamos. Esto plantea importantes desafíos en términos de seguridad, protección de la reputación y verificación de la información.

La guerra híbrida es una estrategia para debilitar al enemigo a través de métodos no convencionales, por lo que utiliza herramientas como la desinformación, ciberataques, guerra psicológica, entre otros. Los Deep Fakes son parte de este tipo de guerra, y son ideales para atacar opositores políticos en tiempos de guerra electoral. Los actores estatales y no estatales tienen la capacidad de crear escenarios falsos que pueden inducir al pánico o a la desconfianza, lo que los hace especialmente peligrosos para los países que tienen sistemas democráticos.

Por ejemplo, durante las elecciones en Taiwán de 2024, se difundió un video deepfake del presidente chino Xi Jinping, en el que expresaba su apoyo a candidatos de la oposición taiwanesa, como el Kuomintang, quien ha adoptado una postura pragmática en los últimos años con el Partido Comunista Chino. El video tenía como objetivo sembrar confusión en el electorado y afectar la percepción de la influencia china en la política de Taiwán. En una investigación posterior de parte de expertos en ciberseguridad, revelaron que el video presentaba inconsistencias en la sincronización de labios y anomalías en la entonación de la voz, confirmando su origen sintético.

En un mundo donde la manipulación de la información y los ciberataques son cada vez más sofisticados, donde el Deep Fake es uno de ellos, es fundamental desarrollar habilidades avanzadas en ciberdefensa, hacking ético e ingeniería social. Si quieres especializarte en este campo y estar preparado para enfrentar los desafíos de la guerra cibernética, inscríbete en el Diploma Internacional en Ciberdefensa, Hacking Ético e Ingeniería Social de Goberna. Adquiere herramientas para proteger infraestructuras digitales detectar vulnerabilidades y combatir la desinformación en el ecosistema digital.

De la misma forma, el potencial de los Deep Fakes no se limita a ser una estrategia de desprestigio, sino que son empleados en operaciones psicológicas (PSYOPS). Por ejemplo, previo a las elecciones generales del Reino Unido en 2024, se anticipó una difusión de deepfakes, y efectivamente ocurrió. Keir Starmer, actual primer ministro y líder del partido laborista, salió en un vídeo donde supuestamente insultaba a sus colaboradores y expresaba desdén por la ciudad de Liverpool, sede de una conferencia de su partido en aquel entonces. El vídeo logró acumular cerca de 1.5 millones de reproducciones en plataformas como X. Esto nos demuestra el potencial de esta táctica en operaciones psicológicas.

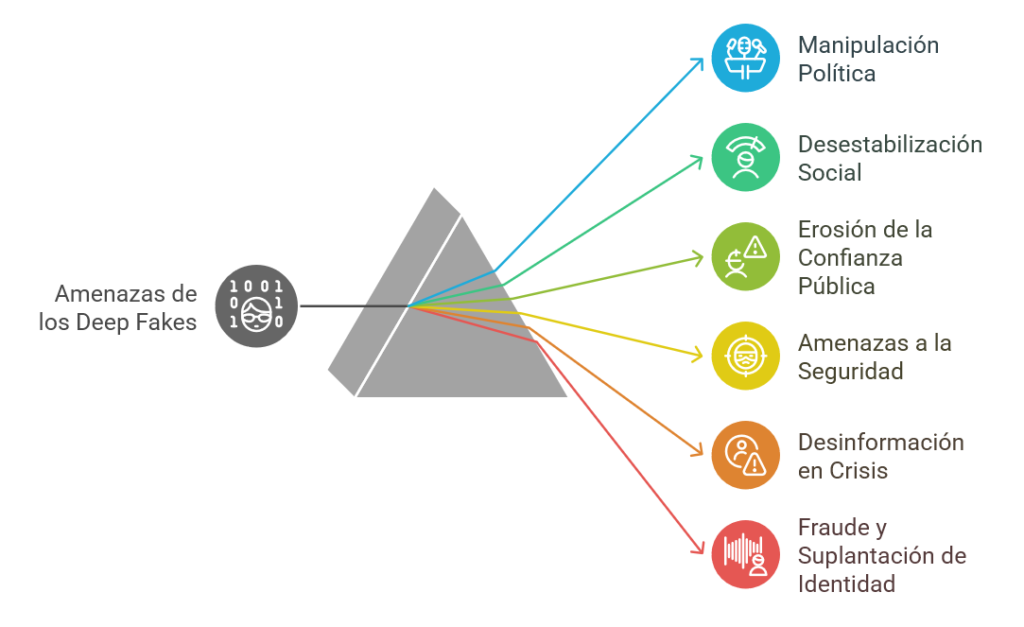

El impacto de los Deep Fakes es significativo y representa una amenaza creciente en distintos ámbitos. Uno de sus principales riesgos es la manipulación política, ya que permite la difusión de noticias falsas y la alteración de declaraciones de figuras públicas, lo que puede generar crisis diplomáticas o afectar procesos electorales. Asimismo, contribuyen a la desestabilización social al sembrar dudas sobre la veracidad de la información, erosionando la confianza en los medios de comunicación y en las instituciones gubernamentales.

Además, la proliferación de contenido manipulado fortalece la erosión de la confianza pública, generando incertidumbre sobre lo que es real o falso y debilitando la credibilidad de gobiernos e instituciones. Incluso, en el ámbito de la seguridad, los Deep Fakes pueden ser parte de operaciones de desinformación como detallamos en el anterior subtítulo. Pero esto no termina acá, sino que también tienen el potencial de ser una herramienta para la suplantación de identidad y fraudes financieros, permitiendo la clonación de voces e imágenes para estafas políticas y económicas.

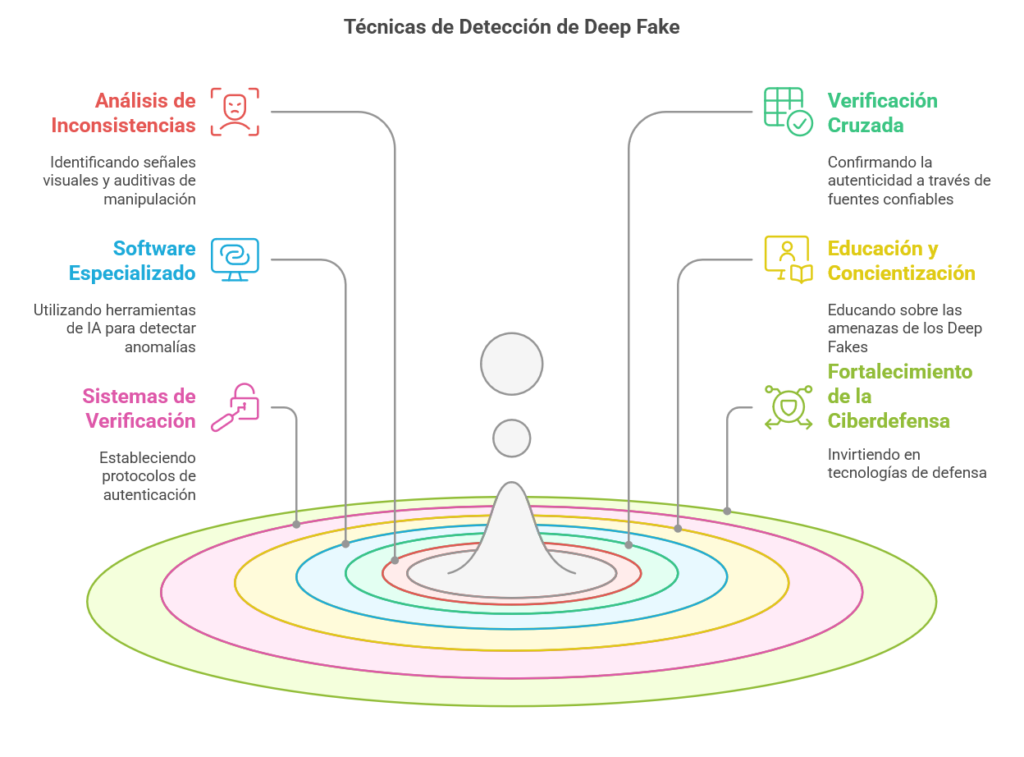

Como hemos visto a lo largo de este artículo, identificar un Deep Fake puede llegar a ser complicado para la población y pueden estar sujetos a distintas PSYOPS, por lo que acá recopilamos el uso de herramientas y técnicas de análisis para identificar un Deep Fake:

En torno a la defensa estratégica si sufres ataques de Deep Fakes, es fundamental fortalecer su imagen pública como figura política, asegurando que su reputación no sea fácilmente manipulada. Además, es crucial implementar respuestas rápidas que desmientan la información falsa antes de que se viralice y genere consecuencias irreversibles. Si bien inteligencia artificial generó esta arma, también juega un papel clave en la defensa contra esta amenaza, ya que puede ser aplicada para detectarlos con mayor precisión. En este contexto, también las PSYOPS deben evolucionar para incluir estrategias de resistencia informativa, promoviendo campañas de comunicación que refuercen la confianza pública y la veracidad de los contenidos, neutralizando así los intentos de manipulación digital.

Los Deep Fakes se han convertido en una amenaza real para la estabilidad política y la seguridad informativa, siendo utilizados en guerra híbrida y operaciones psicológicas para manipular la opinión pública y desestabilizar democracias. Casos recientes en Taiwán y el Reino Unido evidencian su impacto, donde videos falsificados buscaron influir en procesos electorales y erosionar la confianza en las instituciones.

Para contrarrestar esta amenaza, es clave fortalecer la ciberdefensa, el hacking ético y la resistencia informativa, combinando tecnologías de detección con estrategias de PsyOps que refuercen la confianza pública. La lucha contra los Deep Fakes requiere capacitación especializada y respuestas rápidas, garantizando así la protección de la verdad en la era digital.